D'après nos confrères de Le Figaro, le ministre américain de la Défense, Pete Hegseth, a fixé mardi un ultimatum à la start-up d'intelligence artificielle (IA) Anthropic pour qu'elle lève toutes les restrictions à l'utilisation de son IA par le Pentagone. La jeune société californienne a jusqu'à vendredi à 23h01 heure française pour s'exécuter, faute de quoi le ministre entend user d'une loi votée en 1950 qui permet de forcer une entreprise privée à produire des biens pour la défense nationale, a indiqué un responsable à l'AFP.

Anthropic, fondée en 2021 par des anciens d'OpenAI, a toujours revendiqué une approche éthique de l'IA. Le ministre entend également, en cas de refus, de faire inscrire Anthropic sur la liste des sociétés qui présentent «un risque pour les approvisionnements». Les entreprises figurant sur cette liste font l'objet de restrictions drastiques en matière de contrats avec le gouvernement américain, lequel renonce de facto purement et simplement à les utiliser, ce qui ne serait pas le cas dans cette configuration.

Ce qu'il faut retenir

- Le ministre américain de la Défense, Pete Hegseth, a fixé un ultimatum à Anthropic pour lever les restrictions sur son IA.

- Anthropic a jusqu'à vendredi à 23h01 heure française pour s'exécuter.

- En cas de refus, le ministre entend user d'une loi votée en 1950 pour forcer Anthropic à produire des biens pour la défense nationale.

Contexte et enjeux

Le ministère a demandé à ses fournisseurs d'IA de lever les restrictions d'utilisation de leurs modèles par défaut, pour élargir les cas d'usage possibles tant qu'ils restent dans la légalité. Tous ont donné leur accord, y compris Anthropic, mais la jeune entreprise californienne a souhaité empêcher le recours à son modèle d'IA Claude dans deux cas, la surveillance de masse des populations et l'automatisation d'une attaque mortelle.

« Cela n'a rien à voir avec la surveillance de masse et l'utilisation des armes autonomes », a affirmé le responsable américain. « Nous poursuivons nos discussions de bonne foi relatives aux usages (de l'IA) », a déclaré à l'AFP un porte-parole d'Anthropic. L'objectif, selon lui, est de s'« assurer qu'Anthropic peut continuer à soutenir la mission de sécurité nationale du gouvernement en accord avec ce que nos modèles peuvent réaliser de façon responsable et fiable ».

Conséquences et perspectives

La liste des sociétés qui présentent « un risque pour les approvisionnements » s'applique généralement à des sociétés dont les autorités américaines craignent que leurs produits ne servent à des activités susceptibles de menacer la sécurité nationale des États-Unis. Ne figurent actuellement sur la liste que des sociétés étrangères, dont l'équipementier chinois Huawei ou le spécialiste russe des logiciels antivirus Kaspersky.

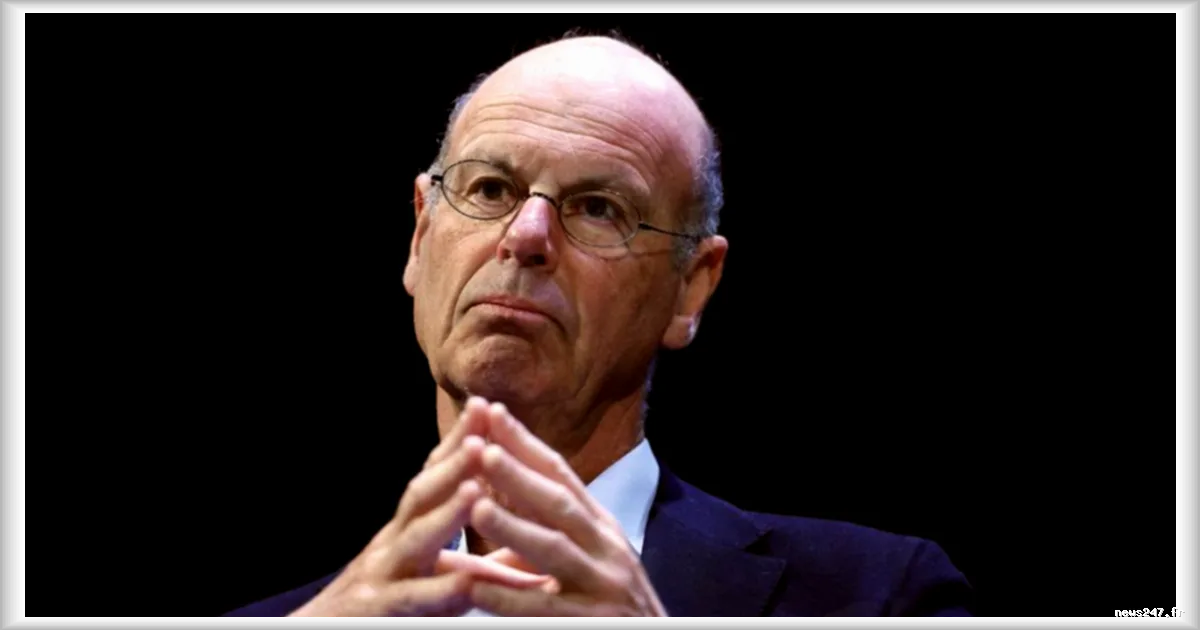

L'ultimatum intervient après une rencontre mardi entre Pete Hegseth et le patron d'Anthropic, Dario Amodei. La rédaction de Le Figaro révèle que cette rencontre a été suivie de près par les autorités américaines, qui souhaitent garantir que les technologies d'IA soient utilisées de manière responsable et sécurisée.

En conclusion, l'ultimatum du ministre américain de la Défense à Anthropic soulève des questions importantes sur l'utilisation de l'IA dans les domaines de la défense et de la sécurité. Les prochaines échéances seront à surveiller de près pour comprendre les conséquences de cette décision et les implications qu'elle pourrait avoir pour l'avenir de l'IA.